Whisper, ou l’oreille presque universelle : ce que les chiffres disent vraiment

Imaginez un interprète capable de travailler dans 99 langues, de détecter automatiquement laquelle est parlée, de transcrire et de traduire simultanément — le tout sans qu’on lui ait fourni le moindre exemple de la tâche précise qu’on lui demande d’accomplir. Ce n’est pas un scénario de science-fiction : c’est exactement ce que réalise Whisper, le système de reconnaissance vocale publié par OpenAI en septembre 2022. Il serait tentant de s’arrêter là, le souffle coupé par l’exploit. Ce serait une erreur.

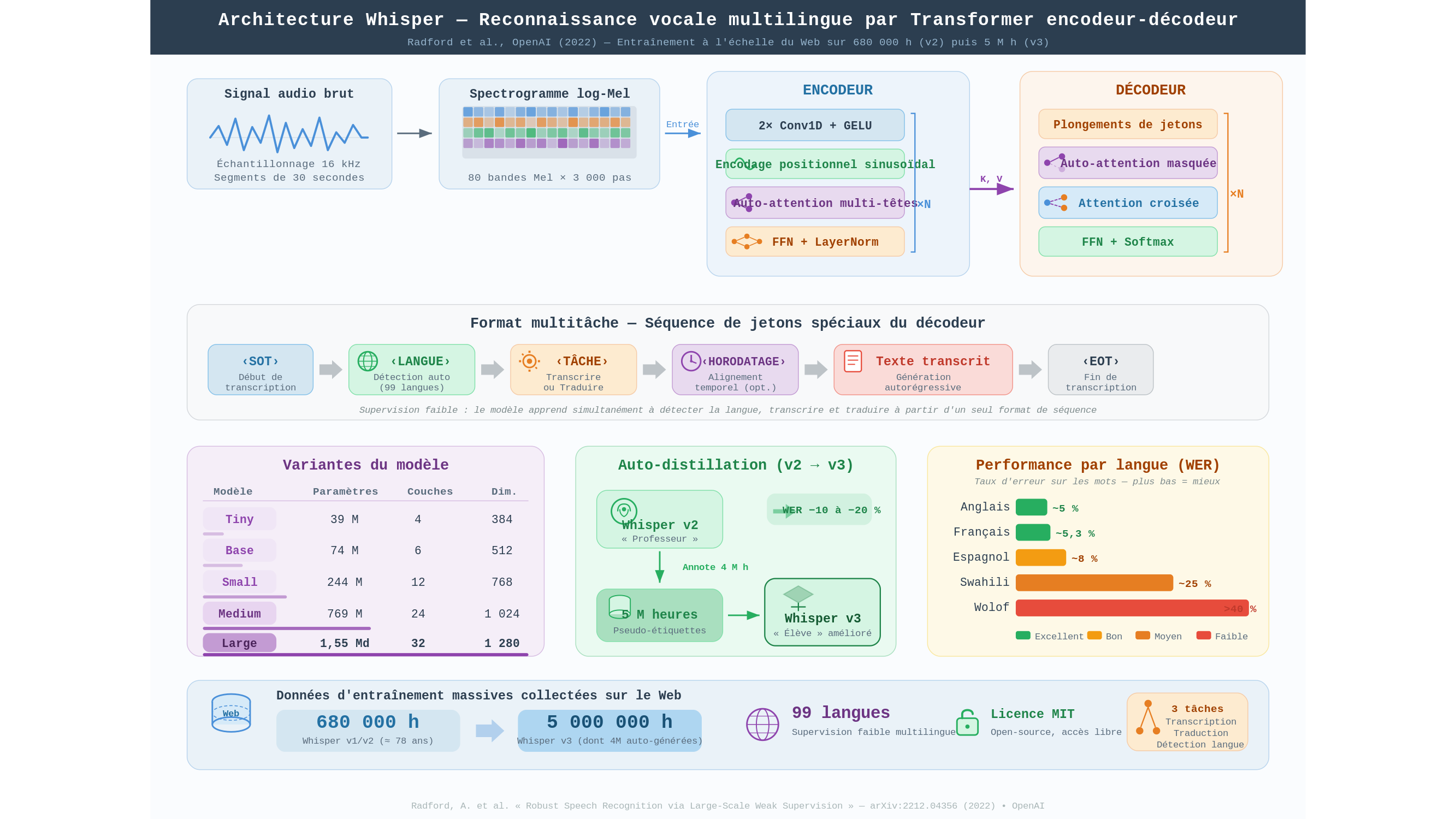

Le paper original, disponible sur ArXiv (voir sources), décrit un modèle entraîné sur 680 000 heures de données audio collectées sur le Web. Pour mettre ce chiffre en perspective : si l’on écoutait cet ensemble audio sans interruption, il faudrait près de 78 ans. La version la plus récente, large-v3, va bien au-delà : elle a été entraînée sur 5 millions d’heures — dont 4 millions générées par le modèle lui-même dans un processus d’auto-distillation, Whisper large-v2 annotant ses propres prédictions pour nourrir son successeur. Ce mécanisme d’auto-alimentation est en lui-même remarquable, et soulève une question que nous retrouverons : quels biais se transmettent, voire s’amplifient, dans cette chaîne ?

Whisper repose sur une architecture de type transformeur — un réseau de neurones à attention, dont le principe consiste à pondérer dynamiquement les relations entre toutes les parties d’une séquence — avec cinq variantes de taille croissante, baptisées tiny, base, small, medium et large. La plus petite tient en 39 millions de paramètres et s’exécute sur un ordinateur ordinaire ; la plus grande en mobilise 1,5 milliard. Cette gamme n’est pas un détail commercial : elle conditionne directement l’accessibilité de l’outil. Une radio communautaire au Sénégal ou une bibliothèque en zone rurale peuvent déployer la version tiny sur du matériel modeste, là où la version large exigerait une infrastructure de calcul significative.

La qualité des résultats suit logiquement cette hiérarchie de taille, mais une autre hiérarchie est bien plus importante : celle des langues elles-mêmes. Pour l’anglais et le français, le taux d’erreur sur les mots transcrits (word error rate, ou WER) avoisine 5 %, ce qui est excellent. Pour de nombreuses langues africaines ou minoritaires — le swahili, le wolof, le breton —, ce taux peut dépasser 40 %. Les auteurs indiquent que large-v3 apporte une amélioration notable sur ces langues à faibles ressources, et la réduction du taux d’erreur de 10 à 20 % par rapport à large-v2 confirme que la progression n’a pas atteint son palier. Mais une question demeure ouverte : à partir de quel seuil d’erreur un outil de transcription est-il véritablement utilisable dans un contexte médical, judiciaire ou éducatif ? Le paper ne la pose pas.

Ce déséquilibre n’est pas une anomalie marginale : c’est le reflet direct de la distribution des données d’entraînement. Sur les 680 000 heures du modèle original, la part consacrée à l’anglais est si dominante qu’elle écrase mécaniquement la représentation des autres langues. Et si large-v3 compense en partie par le volume, l’origine de ce volume reste opaque. Le modèle est, en quelque sorte, une oreille parfaite pour qui parle les langues du Web — et une oreille encore perfectible pour qui parle les langues du monde.

Qu’est-ce que cela signifie concrètement ? Qu’un outil présenté comme « universel » reproduit en réalité, avec une précision mathématique, les inégalités de représentation numérique préexistantes. L’optimiste fera valoir, non sans raison, que la comparaison juste n’est pas « Whisper contre l’idéal » mais « Whisper contre l’absence de solution » : pour une organisation de préservation linguistique travaillant sur une langue à faibles ressources, même un taux d’erreur élevé est préférable à zéro infrastructure de reconnaissance vocale. La licence MIT, qui autorise toute modification et redistribution, permet en outre à des équipes comme celles gravitant autour de Mozilla Common Voice d’affiner le modèle sur des corpus ciblés — mais cela suppose du temps, des compétences techniques et des données annotées que la plupart des communautés linguistiques minoritaires ne possèdent pas.

Ce point sur les données est d’ailleurs le nœud central d’une critique que le paper lui-même ne peut pas résoudre : l’opacité des corpus d’entraînement. La publication du code source sous licence libre ne constitue pas un audit des données. Sans transparence sur l’origine exacte de ces millions d’heures — quels sites, quelles émissions, quels locuteurs, avec quel consentement —, il est impossible de vérifier que les voix collectées ont été traitées conformément aux droits fondamentaux des personnes concernées. Ce n’est pas une question d’ergonomie ou de performance ; c’est une question de droit, sur laquelle le paper reste silencieux.

Il faut cependant rendre justice à ce que Whisper accomplit d’un point de vue technique. Le principe de la généralisation sans apprentissage spécifique (zero-shot) — la capacité du modèle à traiter des accents, des domaines ou des contextes jamais rencontrés lors de l’entraînement — est l’un des résultats empiriques les plus remarquables du travail. Là où un système classique nécessiterait des données d’entraînement spécifiques pour chaque nouvelle condition acoustique, Whisper généralise. C’est l’équivalent d’un lecteur qui, ayant appris à déchiffrer des centaines de polices de caractères, parviendrait à en lire une nouvelle sans jamais l’avoir vue — non par hasard, mais parce qu’il a intériorisé les principes de la forme alphabétique.

Enfin, la fusion en un seul modèle de trois tâches autrefois séparées — transcription, détection de langue, traduction vers l’anglais — mérite qu’on s’y arrête. Ce n’est pas une simple commodité d’interface : c’est une décision architecturale qui révèle une philosophie. En entraînant un même réseau à résoudre ces trois problèmes conjointement, OpenAI parie que les représentations utiles à l’un sont utiles aux autres. Ce pari semble empiriquement validé — le modèle a été téléchargé près de 5 millions de fois sur Hugging Face, ce qui en fait l’un des outils audio les plus déployés au monde. Mais ce succès introduit une dépendance : la traduction que produit Whisper n’est pas arbitrairement multilingue — elle est systématiquement dirigée vers l’anglais. Pour qui veut transcrire du wolof en français, ou du breton en espagnol, le modèle ne suffit pas.

La question qui reste ouverte — et qui sera décisive pour l’avenir des outils de ce type — n’est pas technique. Elle est politique au sens le plus précis du terme : qui finance la production des données annotées pour les langues à faibles ressources ? Mozilla Common Voice et des projets équivalents font un travail remarquable, mais avec des moyens infiniment inférieurs à ceux d’OpenAI. Le modèle de publication ouverte crée une asymétrie étrange : les outils sont partagés, mais le coût de leur amélioration pour les langues minoritaires repose sur des volontaires. Pendant ce temps, les mêmes outils, précis pour les grandes langues et déployables sans infrastructure lourde, répondent aussi exactement aux besoins d’États souhaitant surveiller leurs populations. La licence MIT ne règle ni l’une ni l’autre de ces équations.

Sources

- Radford, A., Kim, J. W., Xu, T., Brockman, G., McLeavey, C., & Sutskever, I. (2022). Robust Speech Recognition via Large-Scale Weak Supervision. ArXiv. https://arxiv.org/abs/2212.04356

- Modèle Whisper large-v3 sur Hugging Face : https://huggingface.co/openai/whisper-large-v3

- Dépôt GitHub officiel : https://github.com/openai/whisper