Simuler sans comprendre : ce qu’un modèle neuronal apprend quand il imite la physique quantique

Il faut parfois plusieurs heures, sinon plusieurs jours de calcul, pour qu’un ordinateur déduise comment un matériau se comportera électriquement lorsqu’on l’étire ou le comprime. Ce délai n’est pas le signe d’une insuffisance technique provisoire : il est inscrit dans la nature même des équations en jeu. La théorie de la fonctionnelle de la densité — dite DFT, de l’anglais Density Functional Theory — est l’outil de référence des physiciens du solide pour prédire les propriétés électroniques d’un matériau à l’échelle atomique. Elle résout, approximativement mais rigoureusement, une version simplifiée de l’équation de Schrödinger pour un ensemble d’électrons en interaction. Rigoureuse, précise, onéreuse en temps machine : tels sont ses trois attributs fondamentaux, et c’est précisément dans cet espace — entre la rigueur d’une méthode coûteuse et le besoin d’explorer rapidement des dizaines de matériaux candidats — qu’un modèle Transformer entraîné sur des données DFT vient se glisser.

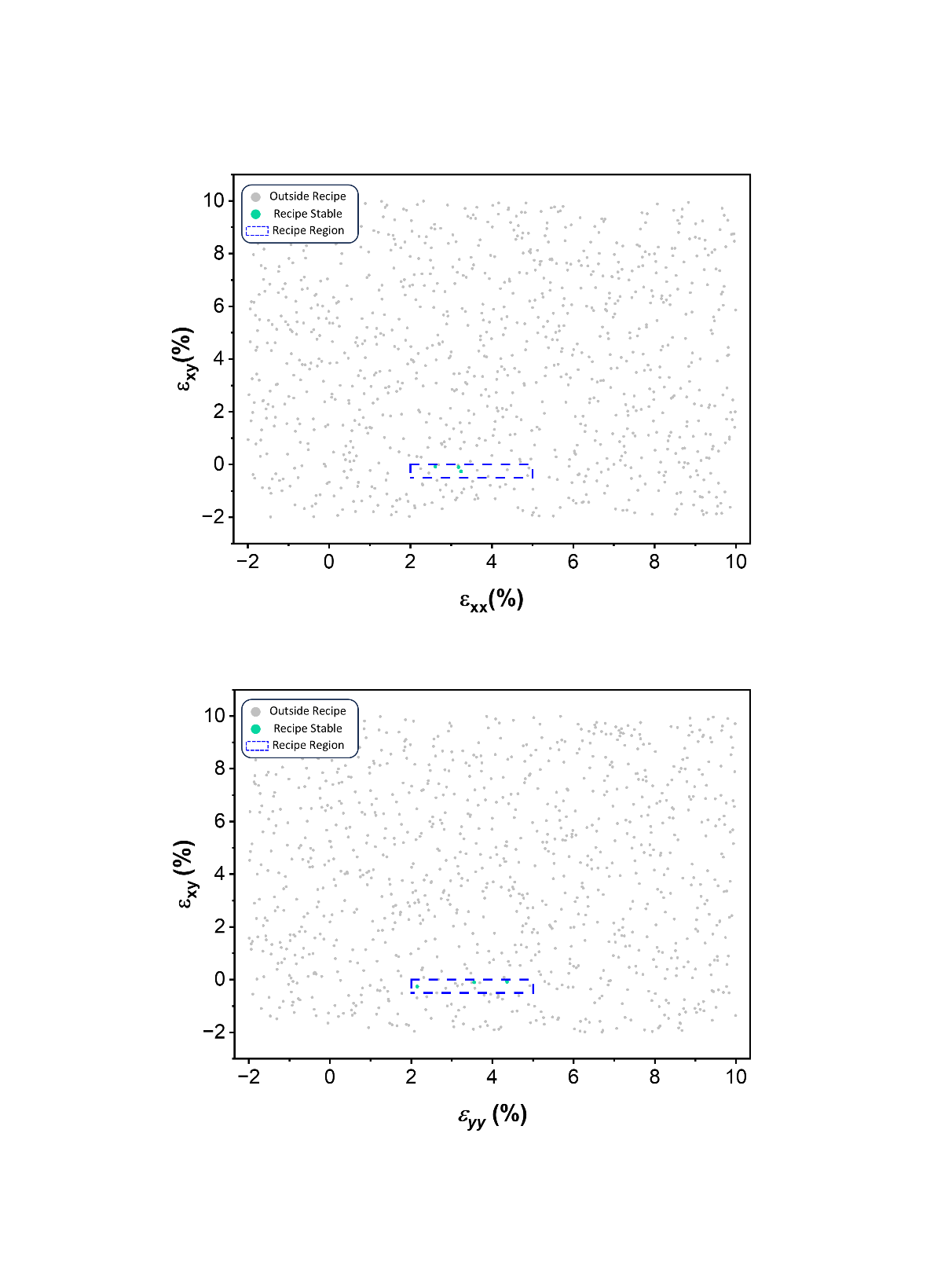

Des chercheurs de l’Université de l’Illinois à Urbana-Champaign et de l’Université de Californie à San Diego ont développé une architecture neuronale capable de prédire simultanément plusieurs propriétés électroniques de matériaux bidimensionnels soumis à des contraintes mécaniques, avec une erreur moyenne de 0,0103 électronvolt. Ce chiffre mérite qu’on s’y arrête. Un électronvolt est l’énergie acquise par un électron soumis à une différence de potentiel d’un volt — l’unité naturelle des processus électroniques à l’échelle atomique. Une erreur de l’ordre du centième d’électronvolt est, dans ce contexte, une précision que beaucoup de physiciens n’auraient pas d’emblée anticipée d’un modèle d’apprentissage automatique, c’est-à-dire d’un système qui n’a jamais résolu une seule équation quantique.

Mais qu’est-ce, au juste, qu’un matériau bidimensionnel ? L’expression désigne des matériaux dont l’épaisseur se réduit à quelques atomes — parfois à un seul plan atomique. Le graphène, cet arrangement d’atomes de carbone en nid d’abeilles dont la découverte valut le prix Nobel à Andre Geim et Konstantin Novoselov en 2010, en est l’exemple emblématique. Ces structures présentent des propriétés électroniques qui n’existent pas dans leurs équivalents tridimensionnels, ou qui en diffèrent radicalement. Parmi les leviers dont disposent les physiciens pour moduler ces propriétés, l’ingénierie de déformation occupe une place centrale : elle consiste à étirer, comprimer ou cisailler légèrement le matériau afin de modifier la structure de ses bandes d’énergie électronique, et donc ses propriétés semi-conductrices, optiques ou magnétiques. Un même matériau, légèrement distordu, peut ainsi se comporter comme un isolant, un semi-conducteur ou un conducteur. Ce n’est pas une métaphore : c’est la réalité quantique de la matière à cette échelle.

Le modèle proposé agit, en quelque sorte, comme un jumeau numérique de la simulation quantique : formé sur un corpus de calculs DFT, il en a intériorisé les structures implicites au point de pouvoir reproduire les résultats — non par compréhension des lois physiques, mais par généralisation statistique. L’analogie avec la traduction automatique n’est pas sans pertinence : un grand modèle de langue n’a pas appris la grammaire en en étudiant les règles, mais en observant suffisamment d’exemples pour en reproduire les structures. De même, le Transformer n’a pas résolu l’équation de Schrödinger — il a appris à imiter celui qui la résout. La différence entre ces deux opérations, qu’on serait tenté de juger négligeable à l’heure des résultats, est pourtant celle qui conditionne toute la suite.

Car un imitateur, aussi talentueux soit-il, n’est pas infaillible : il excelle dans les configurations proches de ce qu’il a vu, mais que se passe-t-il lorsqu’on l’expose à un matériau vraiment inédit, dont les paramètres s’écartent de ceux qui ont servi à son entraînement ? Cette question — la généralisation hors distribution, comme disent les spécialistes d’apprentissage automatique — n’est pas clairement résolue dans les travaux disponibles. Elle trace précisément la frontière entre un outil de recherche robuste et un artefact statistique brillant mais fragile. Il est encore trop tôt pour affirmer que cette limite soit insurmontable, mais la prudence s’impose : les performances annoncées sont mesurées sur des données structurellement proches de l’entraînement, et l’extrapolation au-delà de ce périmètre reste une conjecture.

Le caractère multi-cible du modèle est, pour sa part, un point remarquable. En DFT, chaque propriété calculée suppose généralement une procédure distincte, des paramétrisations souvent différentes. Qu’un seul modèle puisse produire un ensemble cohérent de prédictions simultanées suggère qu’il a capturé quelque chose de la structure profonde des corrélations entre ces grandeurs. Quelque chose — mais quoi, exactement ? Nul ne le sait vraiment, et c’est en cela que la question dépasse le cadre purement technique.

Une autre dimension mérite d’être tenue en regard, plus structurelle. Si de tels outils se diffusent largement en tant que substituts aux calculs DFT de routine, le risque est de voir progressivement disparaître les compétences que ces calculs forgent. Un étudiant qui n’a jamais appris à construire une simulation DFT, à en interpréter les sorties, à en questionner les approximations, sera-t-il en mesure d’évaluer correctement les résultats d’un modèle qui prétend les imiter ? La vitesse porte un coût pédagogique qui n’apparaît dans aucun bilan de performance. Et la question de l’équité n’est pas moins pressante : un laboratoire bien doté pourra toujours valider les prédictions par l’expérience avant d’y engager des ressources. Un laboratoire sous-équipé — et ils sont nombreux, en particulier dans les pays à revenu intermédiaire — risque d’utiliser ces prédictions sans pouvoir les soumettre à la contre-épreuve du réel. La rapidité d’un outil ne garantit pas une répartition équitable des moyens de le critiquer.

Ce que ce travail met finalement en lumière, ce n’est pas seulement une avancée dans la prédiction des matériaux : c’est une question philosophique que la physique computationnelle n’avait pas encore eu à formuler aussi nettement. Un modèle Transformer formé sur des données quantiques a-t-il appris une représentation utile de la physique des électrons, ou a-t-il simplement appris à interpoler élégamment entre des exemples ? La distinction n’est pas anodine. Elle touche à ce que « comprendre » signifie pour une machine — et, en creux, à ce que ce mot signifie pour nous.

Sources

Note de transparence éditoriale : le papier de référence sur l’architecture Transformer appliquée aux propriétés électroniques de matériaux bidimensionnels sous déformation mécanique, attribué à des chercheurs de l’Université de l’Illinois à Urbana-Champaign (UIUC) et de l’Université de Californie à San Diego, n’a pu être cité avec un identifiant arXiv ou DOI vérifié au moment de la rédaction de cet article. Conformément à la politique éditoriale d’Émergence, aucune référence ne sera inventée. Le chiffre d’erreur (0,0103 eV) et les caractéristiques du modèle sont repris du brief de recherche interne. Cette section sera mise à jour dès identification confirmée de la source primaire.