Pourquoi l’IA peut prouver un théorème et rater l’analogie d’un enfant de huit ans

Un grand modèle de langage contemporain peut résoudre des syllogismes formels que les étudiants en logique trouvent ardus. Ce même modèle peut échouer sur la question qu’un instituteur pose à des enfants de sept ans : « Le soleil est à la Terre ce que le noyau est à ___ ? » La réponse correcte est « l’atome ». Le modèle, parfois, hésite ou se trompe. Cette asymétrie n’est ni un accident de calibration ni un défaut de données d’entraînement. Elle indique, si l’on prend la peine de l’examiner rigoureusement, que la déduction et l’analogie ne sont pas des formes de raisonnement de même nature — et qu’elles n’exigent pas les mêmes propriétés d’un système de représentation.

C’est la thèse de Yiling Wu dans un article théorique déposé sur arXiv en mars 2026 (arXiv:2603.21736v1). La question qu’il pose est simple à formuler, difficile à résoudre : pourquoi le même système — humain ou artificiel — réussit-il certains types de raisonnement tout en échouant sur d’autres qui paraissent comparables ? Sa réponse ne passe pas par les données, ni par les paramètres, ni par la puissance de calcul. Elle passe par la structure des représentations elles-mêmes.

Quatre propriétés

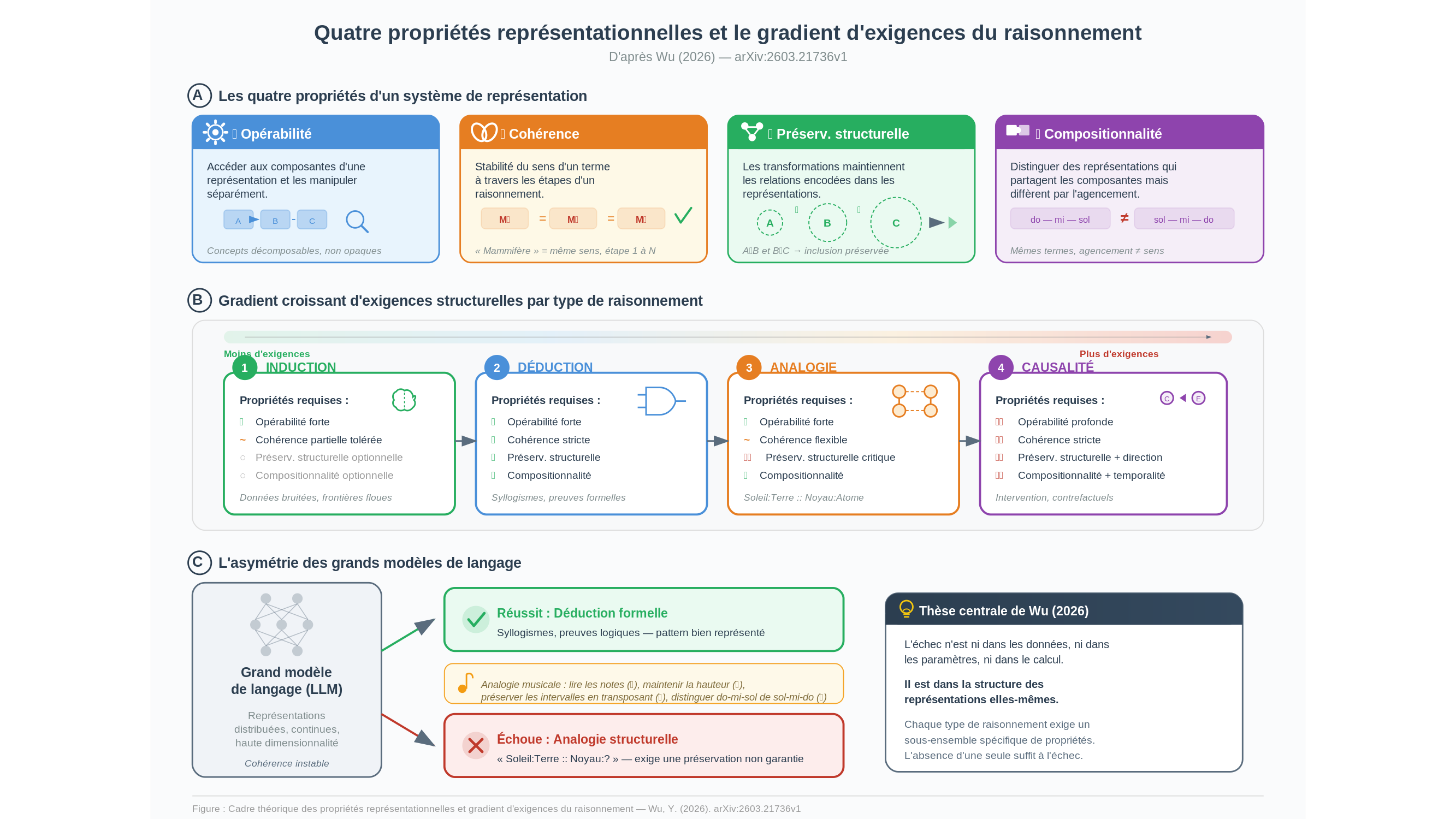

Wu identifie quatre propriétés qu’un système de représentation peut posséder ou non — et dont l’absence entraîne des types d’échec spécifiques et prédictibles.

La première est l’opérabilité : la capacité à accéder aux composantes d’une représentation et à les manipuler séparément. Un système sans opérabilité traite les concepts comme des blocs opaques, reconnaissables en bloc mais non décomposables. Il répond à la ressemblance globale, pas à la structure interne.

La deuxième est la cohérence : la stabilité du sens d’un terme à travers les étapes d’un raisonnement. Pour articuler « tous les mammifères sont à sang chaud » avec « les baleines sont des mammifères », le mot « mammifères » doit désigner exactement la même catégorie dans les deux propositions. Si sa représentation dérive imperceptiblement d’une étape à l’autre, le raisonnement devient formellement invalide sans que cette invalidité soit détectable de l’extérieur.

La troisième est la préservation structurelle : les transformations opérées lors du raisonnement maintiennent les relations encodées dans les représentations. Si A ⊂ B et B ⊂ C, la relation d’inclusion doit traverser toutes les étapes intacte.

La quatrième est la compositionnalité : la capacité à distinguer des représentations qui partagent les mêmes composantes mais diffèrent par leur agencement. « Tous les chiens sont des mammifères » et « tous les mammifères sont des chiens » mobilisent exactement les mêmes termes — leurs implications sont pourtant radicalement opposées.

Une analogie musicale rend visible pourquoi ces quatre propriétés sont irréductibles l’une à l’autre. Pour interpréter une partition fidèlement, un musicien doit lire les notes individuellement et les articuler entre elles (opérabilité), se souvenir que « si » désigne la même hauteur du début à la fin du morceau (cohérence), préserver les intervalles entre les notes lorsqu’il transpose dans une autre tonalité (préservation structurelle), et distinguer do-mi-sol de sol-mi-do (compositionnalité). Supprimer l’une de ces capacités tout en conservant les trois autres produit un type d’erreur précis et distinct. Aucune des trois ne peut compenser l’absence de la quatrième.

Un gradient de contraintes

Les quatre propriétés ne sont pas toutes requises par tous les types de raisonnement. Les différentes formes de raisonnement s’ordonnent selon un gradient croissant d’exigences structurelles.

L’induction — tirer une règle générale de cas particuliers — n’exige qu’une opérabilité forte, assortie d’une tolérance active à l’incohérence partielle. Elle fonctionne avec des données bruitées, des frontières conceptuelles floues, des représentations probabilistes. C’est pourquoi l’apprentissage statistique excelle dans ce registre depuis des décennies : une régression logistique, un classifieur bayésien naïf, un réseau de neurones profond réalisent tous, fondamentalement, de l’induction.

Le raisonnement analogique exige davantage : essentiellement la préservation structurelle. Ce qui valide l’analogie « atome / système solaire » n’est pas une ressemblance de surface — il n’y en a aucune — mais la correspondance des relations : un corps central, des corps périphériques, des forces d’attraction. La théorie de la mise en correspondance structurelle de Dedre Gentner (1983) l’avait montré expérimentalement. Wu lui donne ici un ancrage architectural.

L’inférence causale monte encore d’un degré : selon Wu, elle exige les quatre propriétés simultanément. C’est l’une des formes de raisonnement les plus exigeantes computationnellement, précisément parce qu’elle ne tolère aucune défaillance partielle dans la chaîne représentationnelle. La déduction formelle, quant à elle, repose en priorité sur la cohérence et la compositionnalité — mais sa binarité absolue la rend catastrophiquement sensible à la moindre violation de ces deux propriétés.

Le problème du compoundage

Cette binarité a une conséquence mathématique simple et décisive. Si chaque étape d’une chaîne de raisonnement est correcte avec une probabilité p, la chaîne entière de n étapes l’est avec une probabilité p^n. Pour p = 0,95 — une fiabilité par étape déjà très élevée — et n = 5, on obtient 0,77. Pour n = 10 : 0,60. Pour n = 20 : 0,36. La dégradation n’est pas linéaire ; elle est composée à chaque étape, inexorablement.

Ce schéma correspond exactement aux erreurs observées sur les grands modèles de langage. Une évaluation formelle (DeduCE, ICLR 2025) confirme que la variable prédictive principale des erreurs n’est pas la complexité des prémisses, mais la longueur des chaînes d’inférence. Wu y voit la signature d’un système qui approche les quatre propriétés sans les satisfaire pleinement — une approximation qui suffit pour les raisonnements courts, mais s’effondre à mesure que les chaînes s’allongent.

Deux autres modes d’échec caractéristiques complètent ce tableau. Les effets de contenu : les performances varient avec le thème sémantique des propositions, non avec leur structure logique — comme si le modèle reconnaissait la silhouette d’un raisonnement sans en valider la charpente. Et la cécité aux sophismes : la tendance à accepter des inférences plausibles mais invalides. Ces trois modes — compoundage, effets de contenu, cécité aux sophismes — ne sont pas aléatoires. Ils correspondent précisément aux défaillances que le cadre de Wu prédit pour un système dont les représentations satisfont partiellement, mais pas entièrement, les quatre propriétés.

Limites et questions ouvertes

Le cadre est séduisant dans sa cohérence — peut-être trop. Une question mérite d’être posée : dans quelle mesure Wu prédit-il réellement des comportements futurs, plutôt qu’il ne réinterprète rétrospectivement des résultats connus pour les faire entrer dans une grille préexistante ? Les trois prédictions testables qu’il formule — dégradation compoundée avec la longueur des chaînes, vulnérabilités sélectives selon la propriété perturbée, irréductibilité au passage à l’échelle — n’ont pas encore fait l’objet d’expériences rigoureusement contrôlées et spécifiquement conçues à cet effet. L’appui empirique est indirect.

Demeure également une difficulté méthodologique : comment mesurer qu’un système « satisfait partiellement » la cohérence ou la compositionnalité ? Sans critères formels indépendants, le cadre risque de rester une métaphore explicative plutôt qu’une théorie testable. C’est une limite que Wu reconnaît implicitement, et que la communauté devra combler pour que ce travail devienne véritablement opérationnel.

Ce que la question déplace

La valeur immédiate de ce travail n’est peut-être pas dans ses conclusions — encore partiellement ouvertes — mais dans le déplacement qu’il opère. « Cette IA sait-elle raisonner ? » est, à l’analyse, une question mal posée : elle appelle des réponses binaires là où la réalité est structurée. La question productive devient : « quelles propriétés représentationnelles ce système satisfait-il, et pour quels types de raisonnement est-ce suffisant ? »

Reste alors une question que le cadre formule sans la résoudre, et qui est peut-être la plus difficile. Les quatre propriétés — opérabilité, cohérence, préservation structurelle et compositionnalité — peuvent-elles émerger d’un entraînement statistique sur des données suffisamment riches, ou faut-il les inscrire dans l’architecture par conception explicite ? La réponse à cette question conditionnera sans doute davantage le prochain chapitre de l’intelligence artificielle que les prochains ordres de grandeur dans la course aux paramètres.

Sources

- Yiling Wu, A Representational Framework for Reasoning in AI Systems, arXiv:2603.21736v1 (mars 2026). URL : https://arxiv.org/abs/2603.21736

- Dedre Gentner, « Structure-Mapping: A Theoretical Framework for Analogy », Cognitive Science, vol. 7, n° 2, 1983, p. 155-170. DOI : 10.1207/s15516709cog0702_3

- [Référence DeduCE à compléter avec auteurs, titre exact, actes ICLR 2025 et DOI/URL vérifiable]