La puce fantôme : quand un bidouilleur réveille le processeur dormant de votre Mac

Trente-huit mille milliards d’opérations par seconde. C’est ce que sait faire la puce que vous n’avez pas le droit d’utiliser.

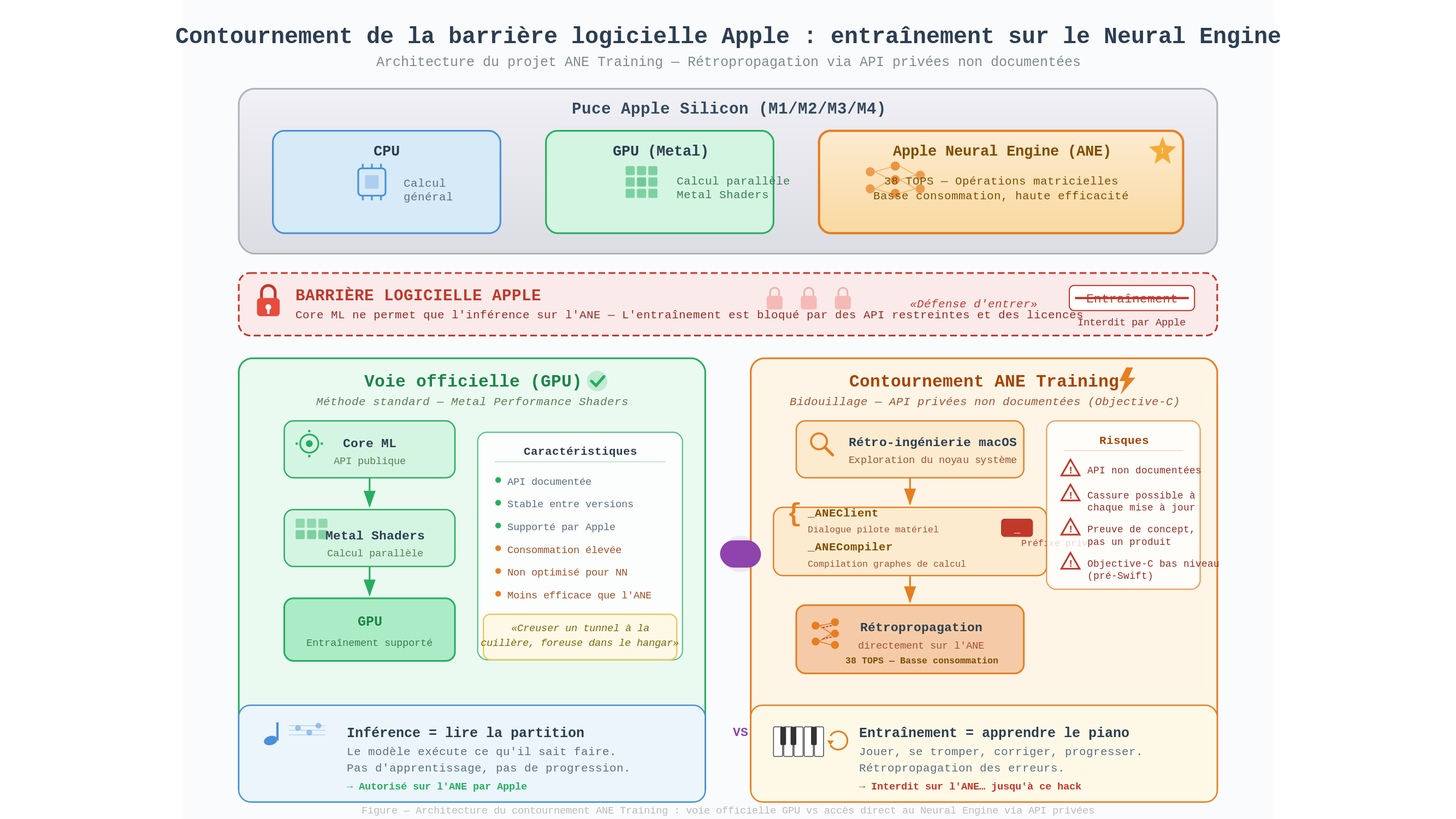

Elle est là, sous la coque en aluminium de votre MacBook, gravée dans le même silicium que le processeur et le GPU, alimentée, fonctionnelle, mentionnée en bonne place dans les keynotes de Cupertino. L’Apple Neural Engine — c’est son nom — reconnaît les visages, transcrit votre voix, suggère la fin de vos phrases. Mais quand il s’agit non plus d’exécuter un modèle d’intelligence artificielle, mais d’en entraîner un, de laisser la machine apprendre par elle-même, Apple a posé un verrou. Pas dans le métal. Dans le logiciel. Et un développeur, armé d’un week-end libre et d’une intuition, vient de crocheter la serrure.

Son projet s’appelle ANE Training. Il le décrit lui-même comme un « bidouillage de fin de semaine ». Six mille étoiles sur GitHub en quelques jours suggèrent que le bidouillage a touché un nerf.

Ce qu’il a fait tient en une phrase, mais ses implications débordent largement : pour la première fois, quelqu’un a réussi à exécuter la rétropropagation — l’algorithme par lequel un réseau de neurones apprend, corrige ses erreurs, s’améliore — directement sur le processeur neuronal d’Apple. La différence entre inférence et entraînement ? Pensez à la musique. L’inférence, c’est lire une partition. L’entraînement, c’est s’asseoir devant un piano, jouer, buter sur un passage, recommencer, ajuster le doigté — et progresser. Apple veut bien que sa puce déchiffre la partition. Mais interdiction de toucher au clavier.

Jusqu’ici, entraîner un modèle sur Mac signifiait passer par le processeur graphique via Metal Performance Shaders, l’interface de calcul parallèle maison. Le GPU fait le travail. Mais les processeurs neuronaux sont conçus expressément pour les opérations matricielles au cœur de l’apprentissage profond — ils consomment moins d’énergie et, pour certaines charges, surpassent le GPU en efficacité brute. Utiliser le GPU quand l’ANE est disponible, c’est un peu comme creuser un tunnel à la cuillère en ignorant la foreuse garée dans le hangar d’à côté.

Alors pourquoi verrouiller la foreuse ?

Pour le comprendre, il faut regarder comment le développeur a procédé. Il a plongé dans les entrailles de macOS et en a remonté deux interfaces de programmation qu’Apple n’a jamais documentées, jamais rendues publiques, jamais destinées aux développeurs extérieurs : _ANEClient, qui dialogue directement avec le pilote matériel du Neural Engine, et _ANECompiler, qui compile les graphes de calcul décrivant la circulation des données dans un réseau de neurones. Ce trait de soulignement en tête de nom, dans la convention d’Apple, est l’équivalent typographique d’un panneau « Défense d’entrer ». Le code est écrit en Objective-C, le langage historique d’Apple — celui d’avant Swift, celui qui descend assez bas pour gratter le silicium là où les abstractions modernes refusent d’aller.

Le résultat est une preuve de concept, pas un produit. Le développeur le dit sans ambages, et il faut l’entendre : ces interfaces privées peuvent changer ou disparaître à chaque mise à jour de macOS. Construire quoi que ce soit de fiable sur ces fondations, c’est bâtir sur du sable mouvant. Apple n’aurait qu’à modifier une ligne dans une prochaine version du système pour que tout s’effondre.

Ce qui fascine, pourtant, c’est moins la prouesse elle-même que ce qu’elle démontre. Le Neural Engine peut entraîner des réseaux de neurones. Le silicium le sait faire. La barrière est purement logicielle — un choix délibéré inscrit non pas dans la physique du transistor, mais dans les restrictions d’une interface de programmation et les lignes d’un contrat de licence.

Ce constat dépasse Apple. Les processeurs neuronaux se multiplient : Qualcomm en intègre dans ses Snapdragon, MediaTek dans ses Dimensity, Intel dans ses Core Ultra. Presque tous appliquent la même logique — inférence ouverte, entraînement verrouillé. Les raisons invoquées oscillent entre la stabilité thermique, la protection de la propriété intellectuelle et, disons-le, la stratégie commerciale. Si votre Mac peut entraîner des modèles localement, efficacement, sans vider sa batterie, le besoin de louer du temps de calcul dans le nuage s’amenuise. Or l’infonuagique est un marché dont la croissance se chiffre en dizaines de milliards. Dans certains cercles de développeurs, on commence à nommer cette tension par un mot : le « droit au calcul » — right to compute.

Le projet ANE Training apporte aussi autre chose de précieux. Il inclut des mesures de performance réelles — débit de calcul, consommation électrique, comportement de la mémoire statique interne du Neural Engine. L’ANE est une boîte noire dont Apple n’a jamais publié de documentation technique détaillée. Chaque mesure arrachée par rétro-ingénierie est une fenêtre ouverte sur un composant que des millions de personnes possèdent sans le connaître.

Est-ce que ça marche bien ? La réponse exige de la prudence. La rétropropagation fonctionne — c’est démontré. Mais les performances ne sont pas comparées systématiquement à celles du GPU, les types de modèles testés restent limités, et la stabilité à long terme d’un entraînement sur des interfaces non documentées est par définition inconnue. Le projet ouvre une porte. Il ne cartographie pas encore ce qui se trouve derrière.

Reste un paradoxe qui mérite qu’on s’y attarde. Apple a bâti une part considérable de son image de marque sur la protection de la vie privée. « Ce qui se passe sur votre iPhone reste sur votre iPhone », martelaient ses affiches géantes. Or la technologie qui rendrait cette promesse la plus tangible pour l’intelligence artificielle — un entraînement entièrement local, où un modèle s’ajuste à vos habitudes d’écriture, apprend votre accent, mémorise votre vocabulaire sans qu’aucune donnée ne quitte jamais l’appareil — est précisément celle qu’Apple refuse d’ouvrir. La puce capable de rendre l’IA véritablement confidentielle existe. Elle est dans votre poche. Elle attend.

Six mille étoiles pour un bidouillage de week-end en Objective-C — un langage que la plupart des jeunes développeurs considèrent comme un vestige. Ce chiffre dit quelque chose sur l’état d’esprit d’une communauté. La rétro-ingénierie, ici, n’est pas un acte de piraterie. C’est un acte de recherche, la méthode artisanale par laquelle des individus explorent les capacités réelles de machines dont les spécifications complètes sont gardées sous clé.

Apple n’a pas réagi. Elle n’en a pas besoin. Il lui suffira de modifier une interface interne pour que la démonstration devienne un souvenir — un château de sable très précisément sculpté, emporté par la marée logicielle suivante. Mais la question que pose ce développeur solitaire, elle, résiste à l’érosion. Elle ne concerne pas seulement Apple, ni le Mac, ni même l’intelligence artificielle. Elle tient en quelques mots, et personne n’a encore trouvé de bonne réponse : à qui appartient vraiment la machine que vous avez dans les mains — à vous qui l’avez payée, ou à celui qui a écrit le logiciel qui décide ce qu’elle a le droit de faire ?